机器学习和目标检测

想象两个相邻的圆。然后想象在这两个圆下面有一条水平线。你无法控制自己,你的大脑看到了一张简单图案的脸。模式识别是人类大脑非常擅长的事情,它使我们能够从非常稀疏的信息中找到意义,也能解释丰富而复杂的模式。我们不仅能在看到一张脸的时候认出它,我们还能把成千上万张不同的脸的图像分开,并记住至少数百张脸的名字。我们中的一些人在这方面比其他人做得更好!

这并不是人类独有的能力,其他物种也可以识别它们所认识的动物的不同面孔,家养动物甚至很擅长识别人类的面孔。基于计算机视觉的机器学习就是尝试制作具有类似能力的软件。没有一种计算机程序可以像我们一样处理各种不同类型的图像,但有许多人工智能程序在识别特定的事物方面做得非常好。对于鸟类观察者和其他博物学家来说,你可以上传照片到网站上,它不仅会告诉你植物或动物是什么,还会告诉你它对自己的猜测有多有信心。对于心理学家来说,有一些程序可以通过观察人脸图像来告诉你显示的是什么情绪。Noldus”FaceReader就是一个很好的例子。对于农业机器人来说,有一些程序可以观察辣椒,确定它们是否成熟,然后告诉机器人如何在不损坏辣椒的情况下用爪子采摘辣椒。

自动目标检测

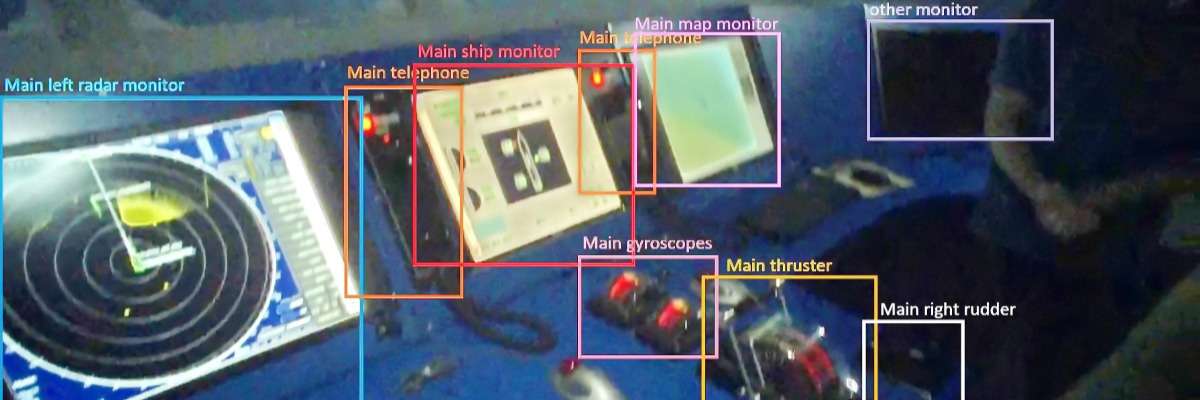

Noldus对这种计算机视觉技术非常感兴趣,不仅在情感识别方面,而且在许多其他应用领域。其中之一是人因或用户体验研究领域的目标检测与识别。在飞机驾驶舱或舰桥等复杂环境中,有许多不同的元素,如雷达屏幕或控制杆。对于研究人员来说,在视频中手工标记这些是一项可怕的工作。

这项技术真正有趣和有用的地方是当物体检测技术与眼球追踪技术相结合时。这正是Noldus在crossing项目中一直在做的。这意味着我们不仅可以自动判断船长是在看舰桥的右侧,还可以判断他或她是在看雷达屏幕。当船长走动时,当雷达显示器切换到不同的显示器时,我们都可以测量。经过人工智能训练的计算机视觉可以识别视频图像中的雷达屏幕。此外,由于这是一个使用特定图像集训练的专业应用程序,如果有两种不同类型的雷达,比如天气和船只,它可以学习区分它们。

自我中心的愿景

对于传统的眼球追踪,这只能通过固定的眼球追踪器来实现,比如在电脑显示器下面。头部不会相对于屏幕移动,系统知道在给定的时间屏幕上显示的是什么,所以它可以计算出如果有人看某个网页的右上角,他们正在看公司的标志。对于固定显示器和坐着不动的人来说,这并不那么困难,但只要这个人站起来开始走动,他们视野的“右上方”意味着每一分钟都有不同的东西,显示器上显示的图像可以分别捕捉。眼球追踪眼镜仍然会记录人们正在看的地方,并将他们所看到的拍摄成视频(这被称为“以自我为中心的视觉”),但将这两者转化为他们正在看的东西的信息是一项昂贵的任务。这就是自动目标检测技术发挥作用的地方。它用于分析以自我为中心的视频,并检测是否有(例如)雷达屏幕在视图中,以及它在3D空间中的位置。

深度学习

该技术使用深度卷积神经网络对每个视频帧执行目标检测。该网络在预定义的对象类别上进行训练,如通用监视器或子类,例如显示雷达的监视器。在测试时,它会通过注释周围的边界框来显示它找到的对象,不需要研究人员付出任何努力就能自动显示它们感兴趣的区域,如本博客顶部的图片所示。最重要的是,该网络可以从单个视频帧中同时检测多个对象。与此同时,眼动仪仍在测量佩戴眼动眼镜的人在看哪里。来自眼动仪的坐标和被检测物体的坐标被转换,使它们彼此处于相同的坐标空间中。所有这些技术组成了一个系统,可以使人们的目光与视频中发现的物体同步,并记录下用户感兴趣的区域的内容。

对设计师有价值

这不是小事,我们开发这个的同事在他的工作中写了超过一百万行代码路口项目.值得吗?实际上,这是非常有价值的信息。它可以让研究人员回答一些问题,比如船长多久向窗外看一次(或者他/她是否太专注于观察仪器了?),驾驶台工作人员如何系统地扫描所有不同的信息来源,以及他们是否注意到警示灯。这些知识在设计安全、可用的系统和培训新船员方面都是至关重要的。

致谢

这里所描述的工作是由乔治·Kapidis在across项目中,该项目由欧盟地平线2020计划资助,作为玛丽·斯科多夫斯卡-居里创新培训网络,项目编号676157。舰桥模拟器的具体工作是与马林.

参考文献

以下论文提供了有关这项技术的更多细节:

G. Kapidis, R. Poppe, E. van Dam, L. P. J. J. Noldus和R. C. Veltkamp "多任务学习提高自我中心行为识别,在2019年IEEE计算机视觉国际会议(ICCV)研讨会上。

G. Kapidis, E. van Dam, R. Poppe, L. P. J. J. Noldus和R. C. Veltkamp "“日常生活场景中自我中心视频的动作检测”,《测量行为2018》,曼彻斯特,英国,2018,第405 - 407页。

G. Kapidis, R. Poppe, E. van Dam, L. P. J. J. Noldus和R. C. Veltkamp,“自我中心视频中基于物体检测的位置和活动分类;系统分析,“智能辅助生活,施普林格,2019。

更多的

注意!安全驾驶

在最近的一项针对骑自行车者的研究中,瑞典VTI的研究人员使用眼球追踪技术、视频记录和行为编码来观察骑自行车者的行为。

有效的安全检查和机场流程

你知道这种感觉吗?你不耐烦地排队等待安检。机场有很多事情要做,安全检查只是其中的一项活动。