推进新对象测试:3D打印和深度学习

最近,我们更新了我们的新物体识别白皮书.该白皮书还探讨了实际对象使用的困境,以及实验室内部和实验室之间存在的许多不一致和缺乏对象标准化的问题。这正是Spry等人在最近的出版物中通过调查3d打印对象[1]的使用而试图解决的问题。

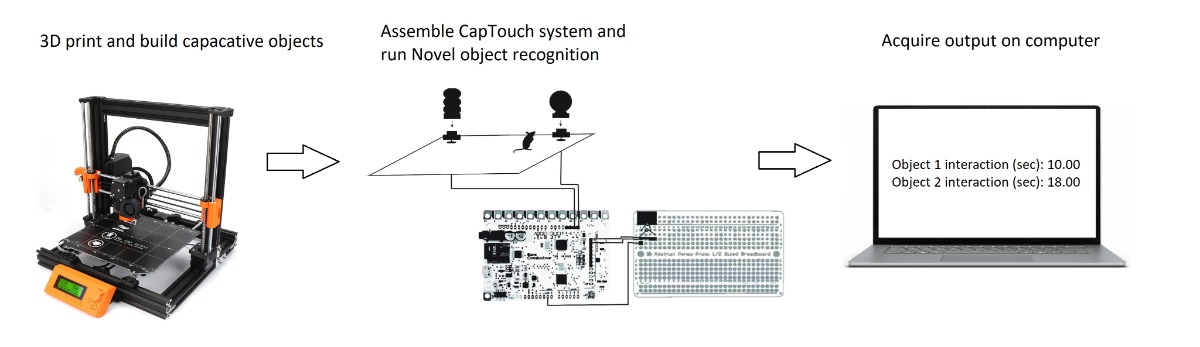

3d打印电容性物体

Spry等人提供了一个原理证明演示,与手动评分相比,使用3d打印电容性物体是执行物体识别任务的一种经济、可靠和精确的方法。这种新方法可能最终有助于建立一种更标准化的物体识别任务方法,这将大大提高基础和应用神经行为研究的可靠性。

快速回顾

物体识别通常包括让被试动物熟悉一系列物体,然后呈现一个新的物体或将一个物体移到一个新的位置。花在探索新奇和/或移位的物体上的时间可以用来推断学习和记忆。

“CapTouch”系统

该创新的“CapTouch”系统有两个版本,估计成本约为85美元:1.0版本使用导电3d打印机灯丝,2.0版本使用传统打印灯丝结合铜胶带。第二个版本的实现是为了在更常见的印刷材料(例如PLA和PETG)中提供额外的低成本对象。

CapTouch 1.0

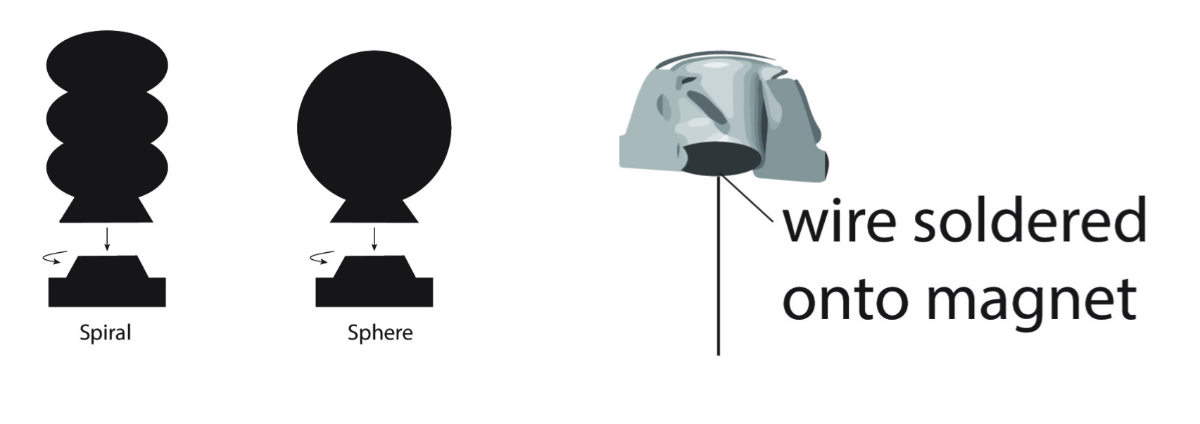

CapTouch 1.0的物体和它们的底座用导电灯丝打印,并使用实心线连接到触摸板上,实心线连接到物体内磁铁。这样就可以连接到触控板上的头引脚。扭转设计确保易于拆卸和附着的对象到基础。

CapTouch 2.0

CapTouch的第二次迭代是在不导电的灯丝中打印的。这些物体是中空的,铜箔带被放置在里面作为电容传感器,通过一个简单的钉孔设计简单地连接到底座上。

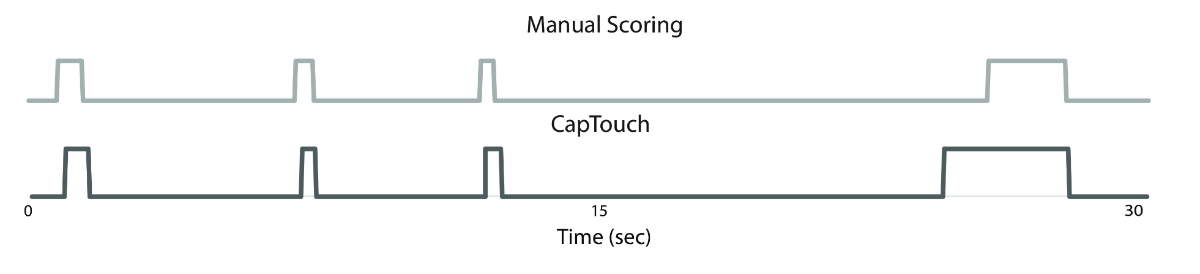

可靠的系统

CapTouch 1.0和2.0与多个记分员的手动评分相比显示出高度的正相关,这表明无论使用哪种迭代,CapTouch系统都是一种可重复和可行的方法。

训练神经网络- EthoVision XT 16

Spry等人指出,目前基于视频的自动化算法往往不可靠,而对物体调查进行手动评分耗时、繁琐且更主观。尽管Spry等人将手动评分和基于电容的新系统进行了比较,但他们并没有将其系统与基于视频的跟踪算法进行比较。

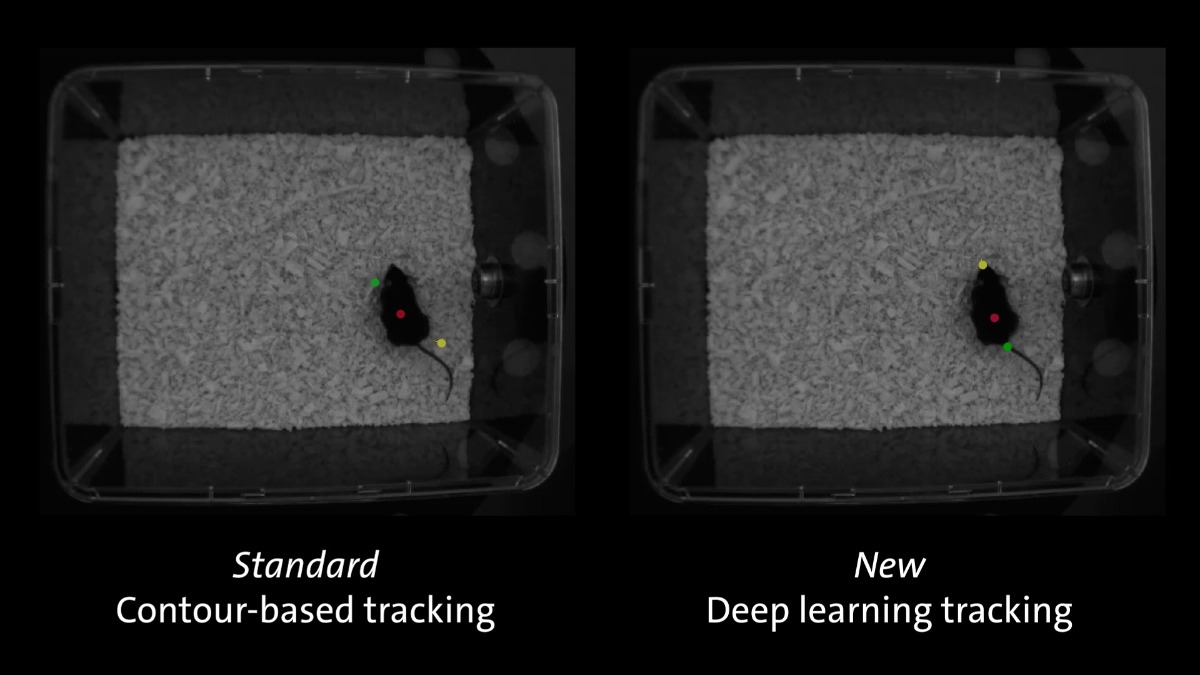

基于轮廓的视频跟踪确实会导致一些不一致,特别是在跟踪过程中由于竞技场中存在的物体而丢失对象时。EthoVision XT 16然而,它引入了基于深度学习的跟踪,使用训练过的神经网络,大大提高了对身体点(鼻尖、中心和尾巴基部)的检测。特别是在新的物体识别测试中,对物体相互作用的检测产生了无与伦比的视频跟踪质量。

最近由Alicia Brantley博士主持的网络研讨会,深入研究了这个主题,并展示了如何使用这个新功能,可以进一步标准化和改进新的对象测试。本次网络研讨会的其他主要议题包括:

- 定义新的对象测试过程和目标

- 了解新物体测试中再现性的主要挑战

- 成功地利用行为跟踪软件增加新对象测试的可靠性

推进研究

CapTouch系统证明了技术进步确实可以通过标准化促进科学质量的提高。然而,由于灯丝(印刷材料)的局限性,以及物体探索的标准,这一系统未来的改进是有保证的。尽管两者之间有很高的相关性,但由于对直接身体接触的要求更高,电容式物体检测到的交互作用确实比手动评分略少。

这种辨别可以使用EthoVision的训练神经网络。在EthoVision XT 16中使用视频跟踪,这基本上是一个交钥匙系统,不需要构建电容性对象,这是一项技能,不是每个研究人员都具备的。

综上所述,Spry等人的这篇论文是推进我们理解动物模型及其基本神经行为机制的重要步骤。输出分辨率只会随着技术的进步而提高,并让我们对这些工作原理有更多的了解。

参考文献

1.斯普林利;弗莱,s.a.;德菲利普;干燥,s.g.;斯蒂芬诺维奇(k.d);Hunnicutt, j .;伯恩斯坦;汤普森,e。e。库什曼J. D.(2021)。 3D-Printed Capacitive Sensor Objects for Object Recognition Assays. eNeuro, 8 (1), 1–9

更多的

测量啮齿动物空间学习的5种已被证实的方法

什么是空间学习?为什么它很重要?我们如何衡量它?在这里,我们深入研究了5种不同的行为测试,专门测量啮齿类动物的空间学习和记忆。

ethvision XT和莫里斯水迷宫:专家提示和技巧

神经科学家Colleen McSweeney博士分享了她使用ethvision XT和Morris水迷宫的专业知识。从简要的历史到有价值的提示和技巧,以下是关于自动跟踪您需要知道的全部内容。